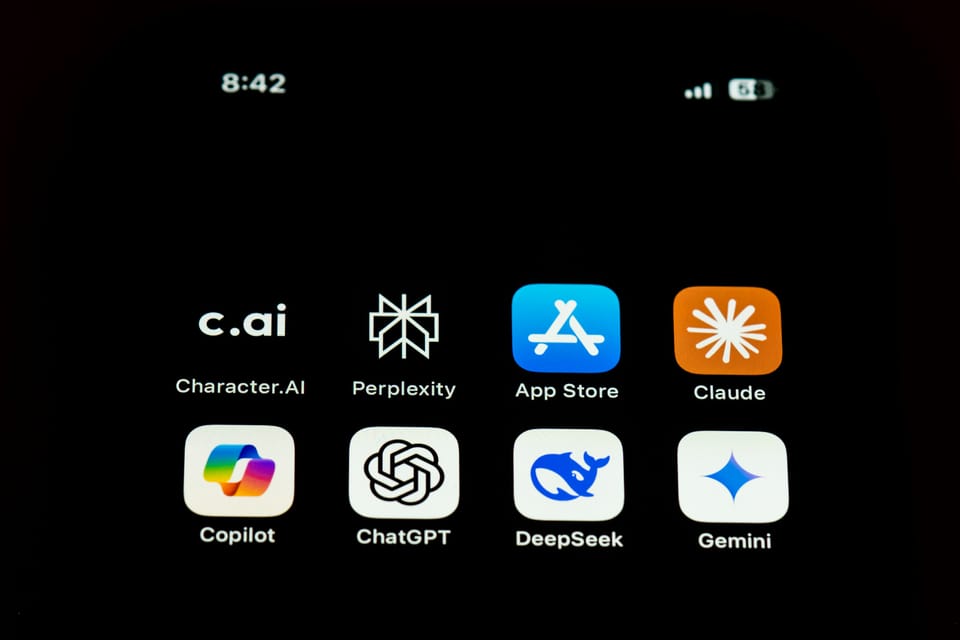

OpenAI、Anthropic、Google罕见联手反蒸馏:DeepSeek、Moonshot、MiniMax用1600万次Claude对话换来什么

4月6日彭博社披露:OpenAI、Anthropic和Google通过Frontier Model Forum共享对抗性蒸馏攻击数据,针对DeepSeek、Moonshot AI、MiniMax。三家中国实验室合计使用2.4万个虚假账户、1600万次Claude对话提取能力。锐报深度解析三家罕见联手背后的术语遮羞布、商业基本盘焦虑,以及"领先六个月"的真正窗口之争。

4月6日,彭博社披露:OpenAI、Anthropic和谷歌已经开始通过Frontier Model Forum——三家公司2023年与微软共建的产业组织——共享针对中国AI公司的"对抗性蒸馏"攻击数据。这是这三家平日里互相挖人、互相争夺客户、互相在国会山下绊脚的前沿实验室,第一次以联盟姿态出现在同一张桌子前。它们要对付的对象只有一个:DeepSeek、Moonshot AI、MiniMax这一批中国AI企业。

事情的引线,是2026年2月Anthropic公开的一份指控。Anthropic声称,它从自家系统日志中识别出了"工业规模的蒸馏攻击"——DeepSeek、Moonshot和MiniMax合计使用约2.4万个虚假账户,与Claude进行了超过1600万次对话,目的并非提问,而是系统性提取Claude的能力,再用这些输出训练自家模型。三家中国实验室的攻击侧重各不相同:DeepSeek集中在基础逻辑与对齐,约15万次;Moonshot押宝在agentic推理与工具调用,约340万次;MiniMax则把火力全部压在agentic编码上,独占1300万次。数字精确到可指控的程度。这才是关键。

为什么蒸馏要加上"对抗性"

蒸馏这个词在AI研究界并不新鲜。2015年Hinton等人那篇经典论文写得明明白白:用一个大模型当老师,让小模型当学生,学生学会模仿老师的输出,以低得多的成本复现大部分能力。这是公开的学术方法,也是过去十年AI业的家常工具。问题不在蒸馏本身,而在它发生的规模、组织度与意图。

Frontier Model Forum新定义的"对抗性蒸馏",落点在三件事:未授权的API调用、批量伪造的账号身份、以及训练目标直接对标对方的能力边界。1600万次对话、340万次调用、1500万次调用——这些数字不属于任何单一研究者的学术兴趣,它们来自系统化、工程化、有明确产品目标的提取行为。原本设计用来对付个体滥用的TOS框架,在这种工业级提取面前结构性失灵。一家公司要用法庭走完一次跨境TOS诉讼,对手新一代模型早已发布两轮。"对抗性"这个形容词,不是话术升级,而是对真实变化的承认:当蒸馏从学术工具变成产业级竞争武器,旧的描述方式已经容纳不下它。OpenAI蒸馏出4o mini、Anthropic蒸馏出Haiku,与外部对手批量蒸馏,差别不是"自家"对"外人"那么简单——前者承担全部训练成本,后者把成本外包给了被蒸馏方。承担与外包,才是分界线。

仇人为何能坐到一张桌前

OpenAI、Anthropic和谷歌平时是死对头。让它们破例坐到同一张桌前的,绝非道德觉醒,而是同一份商业焦虑。

训练一个前沿模型的公开估算成本,已经从GPT-4时代的1亿美元抬升到如今的10亿美元量级——基础设施、数据采购、RLHF人力、长周期对齐研究,每一项都堪称行业级烧钱。这笔账要回本,靠的是模型上线后两年左右的领先窗口期——企业API订阅、消费级订阅、授权许可,都需要"领先"这一资产持续兑现。一组对手只需几千万次API调用、几百万美元账单,就能把数年成果的核心能力浓缩到自家模型里,"训练成本几十亿、复制成本几百万"的不对称会直接击穿前沿研究的回报模型。这不是商业焦虑,是基本盘塌方——下一代模型的算力账单、对齐研究的人力账单、安全评估的合规账单,都要由前一代的领先窗口供养。窗口被压缩到六个月,整个前沿研究的融资逻辑就难以为继。Frontier Model Forum的反蒸馏机制,正是把过去分散在三家公司各自TOS诉讼中的防御行为,合并成一套行业级标准——这是任何成熟产业都会做的事,软件业有反盗版联盟,制药业有专利共享池,半导体业有跨公司知识产权框架。AI业到了不得不做的时候。

六个月的时间窗

2025年1月DeepSeek R1发布之后,关于"R1是不是蒸馏了OpenAI模型"的争论从未停止。OpenAI随后公开表态,掌握DeepSeek通过其API进行大规模蒸馏的证据;微软安全团队同期监测到异常账号活动;Anthropic披露的1600万次Claude对话提取,则把产业级蒸馏的规模第一次摆上台面。蒸馏不是R1成功的全部秘诀,但它确实是这一轮中国前沿模型快速追赶背后被广泛使用的工具,这一点在工程界已无争议。问题不在于"是否发生",而在于"发生到了什么规模、谁在为此买单"。

由此观之,前沿实验室的联手并非话语策略,而是迟到的行业自卫。OpenAI、Anthropic、Google分别投入了数百亿美元算力与数年人力来推到模型能力的边界,这些投入的回收依赖于模型上线后的领先窗口;当对手以工业化方式把这一窗口从两年压缩到六个月,被压缩的不只是利润表,还有继续投入下一代研究的能力。封堵蒸馏渠道、追责伪造账号、发起跨境法律行动,都是任何受害方都会采取的正常防御。Frontier Model Forum把这些动作机制化,同时与美国政府就出口管制、模型权重保护等议题协同,是把分散的防御整合成产业级保护——这与制药业用专利、半导体业用出口管制保护研发投入是同一种逻辑。

对中国前沿模型团队而言,真正需要正视的不是这场联手的"话术",而是它背后的产业现实:免费蒸馏美国前沿模型作为追赶捷径的窗口正在快速关闭。蒸馏成本几乎为零、训练数据不必自建、对齐工程不必从头做——这套低成本路径过去几年支撑了中国大模型的快速迭代,而它从来都建立在"对方不严格执行TOS"的默契之上。这套默契一旦被Frontier Model Forum的共享机制打破,DeepSeek、Moonshot、MiniMax们就必须把过去外包给OpenAI和Anthropic的研发账单,老老实实搬回到自己的资产负债表上。这才是这场联手对中国AI产业最实质的影响——它不是被指控带来的名誉损失,而是商业模式被迫升级的成本压力。

所谓"罕见联手",不外如是——结构性威胁出现时,平日里彼此死磕的对手会迅速合流。这次合流的对象是产业级蒸馏,理由是合法的产品与商业利益保护,工具是行业标准加政策协同。对中国前沿模型而言,这是一记必须接住的信号:靠蒸馏抄近路的时代正在过去,自建训练流水线、自担算力账单、自做对齐研究,迟早要走完一遍。这条路别人走了十年,谁也不能继续白嫖;走完之后,竞争才真正回到技术本身。前路难走,却是必经之路。

读到这里,说明你关注真正重要的事

锐报每周深度分析直送邮箱——财经、地缘、科技,穿透表象。零广告,零废话。